株式会社朝日新聞社の川畑氏、国際学会EMNLPで2年連続採択の快挙

株式会社朝日新聞社が国際学会で快挙達成

株式会社朝日新聞社のメディア研究開発センターに所属する川畑輝氏が、自然言語処理の国際学会EMNLPに2年連続で論文を採択されました。川畑氏の研究は、大規模言語モデル(LLM)の応答内容の真偽を自動評価する手法に関するものであり、国立情報学研究所の菅原朔助教との共同研究成果が詰まっています。本論文では、LLMが出力する結論だけでなく、その過程や根拠の妥当性も評価する手法「REPS」を提案。これは情報受け手にとって重要な視点を持ち、LLMの性能向上や嘘の検知に役立つことが期待されています。朝日新聞社はAI技術の研究開発を積極的に進め、DX(デジタルトランスフォーメーション)に貢献します。

この記事の要約

- 川畑輝氏がEMNLPに2年連続で論文採択される。

- 新たな評価手法「REPS」がLLMの真偽評価を改善。

- 朝日新聞社はAI研究を推進し、DXに貢献予定。

株式会社朝日新聞社(代表取締役社長 角田 克)メディア研究開発センター員の川畑輝が主著した論文(以下「本論文」)が、自然言語処理分野における世界最高峰の国際学会の一つ「Empirical Methods in Natural Language Processing」(以下「EMNLP」)の本会議に採択されました。川畑が主著の論文がEMNLPに採択されるのは2023年に続き2年連続になります。本年は11月12日から16日まで米国フロリダ州マイアミで本会議が開催され、現地で川畑が発表します。

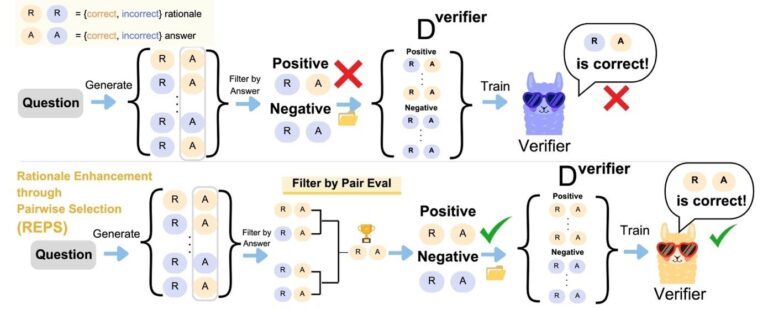

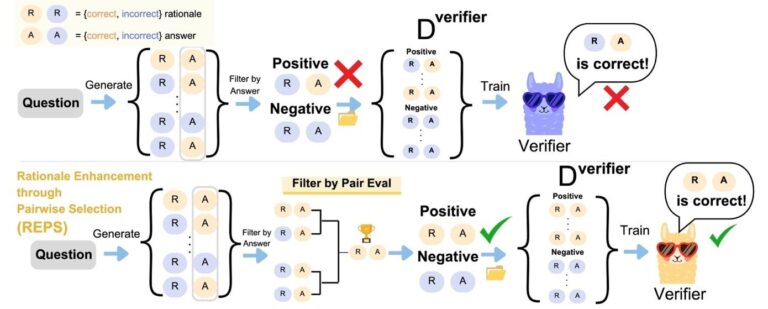

本論文は、国立情報学研究所 菅原朔助教との研究成果をまとめたもので、大規模言語モデル(以下「LLM」)が応答する内容の、真偽性を自動評価するためのLLM(以下「評価用LLM」)の構築手法について提案しました。従来研究において評価用LLMは、評価対象のLLMが出力する最終的な結論の真偽のみに評価の焦点を当て構築されてきました。本論文では、評価対象のLLMが出力する結論だけではなく、結論を導くまでの過程や根拠の妥当性も評価できるような評価用LLMを学習する手法「Rationale Enhancement through Pairwise Selection:REPS」を提案しました。情報の受け手にとっては「結論のみならず結論を導くまでの過程や根拠も重要である」ことに着目したもので、LLM自体の性能向上や、LLMの応答に含まれる嘘(ハルシネーション)の低減や検知にもつながる研究です。

朝日新聞社は最新テクノロジー、特にAI分野での研究を推進し、社内外のLLM技術の利活用やDXに貢献していきます。

■論文について

Akira Kawabata, Saku Sugawara. Rationale-Aware Answer Verification by Pairwise Self-Evaluation. In Proceedings of the 2024 Conference on Empirical Methods in Natural Language Processing (EMNLP 2024), Florida, U.S.A., November 2024. https://arxiv.org/abs/2410.04838

邦題: ペアワイズ自己評価による根拠を考慮した回答検証

■メディア研究開発センターについて

2021年4月に発足しました。人工知能を始めとする先端メディア技術と、新聞社ならではの豊富なテキストや写真、音声などの資源を活用し、社内外の問題解決を目指すとともに、自然言語処理や画像処理をはじめとした先端技術の研究・開発を進めています。

<本リリースについての問い合わせ>

朝日新聞社 メディア事業本部 メディア研究開発センター

E-mail: mrad-contact@asahi.comにお願いします。